Jeszcze kilka lat temu wystarczyło uważać na podejrzane maile i nie klikać w dziwne linki. Dziś to za mało. Cyberzagrożenia zmieniły się tak samo, jak zmienił się internet – stały się bardziej wyrafinowane, trudniejsze do wykrycia i często nie wyglądają już jak atak. To, co kiedyś kojarzyliśmy z błędem użytkownika, dziś często wynika z działań zautomatyzowanych systemów opartych na sztucznej inteligencji.

Teraz przestępcy w sieci wykorzystują deepfake’i, klonowanie głosu, fałszywe aplikacje i złośliwe rozszerzenia, które potrafią zainfekować wszelkie urządzenia nawet bez naszej wiedzy. Rośnie też liczba ataków przez urządzenia smart home, które coraz częściej są częścią naszego codziennego życia.

W tym artykule przyglądamy się nowym zagrożeniom, które pojawiły się w ostatnich latach – pomijamy stare, dobrze znane metody i skupiamy się na tym, co naprawdę może nas dziś zaskoczyć. Bo w świecie, w którym sztuczna inteligencja potrafi oszukać człowieka lepiej niż człowiek – warto być o krok przed nią.

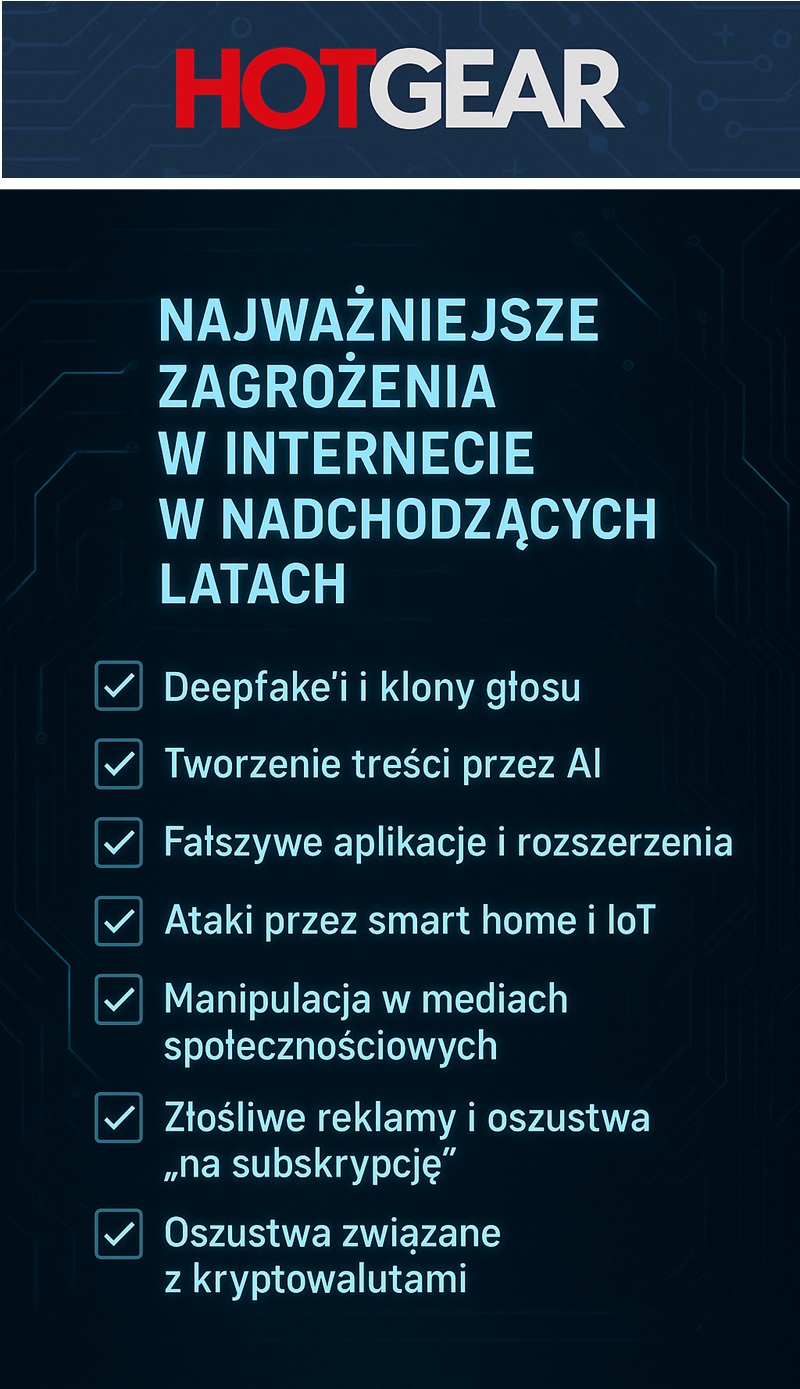

Zagrożenia we współczesnej sieci. Grafika: HotGear

Deepfake’i i klony głosu

Jeszcze niedawno deepfake kojarzył się z internetowymi memami albo filmami z celebrytami, którzy „nigdy tam nie byli”. Dziś to realne narzędzie do oszustw, coraz częściej wykorzystywane w świecie przestępczym. Dzięki zaawansowanym algorytmom, właściwie każdy może stworzyć przekonujący materiał wideo lub audio, w którym ktoś mówi coś, czego tak naprawdę nigdy nie powiedział.

Coraz częstsze są przypadki oszustw, w których przestępcy podszywają się pod członków rodziny, przełożonych lub współpracowników. Przykład? Telefon od „syna”, który prosi o szybki przelew, bo właśnie ma wypadek i nie może mówić zbyt długo. Brzmi znajomo, bo brzmi jak on – tyle że to wygenerowany głos.

W firmach pojawiają się też przypadki fałszywych spotkań wideo z „szefem”, który wydaje pilne polecenia lub żąda danych. W rzeczywistości to jedynie dobrze przygotowany deepfake, oparty na wcześniejszych materiałach dostępnych w sieci.

Jak się przed tym bronić?

- Weryfikujemy prośby finansowe i „niespodziewane” wiadomości — nawet jeśli pochodzą od zaufanych osób.

- Nie działamy pod presją czasu – pośpiech to najlepszy sprzymierzeniec oszusta.

- Zwracamy uwagę na kontekst – jeśli ktoś zachowuje się nietypowo, dopytujemy, nawet jeśli „brzmi jak zawsze”.

Deepfake’i nie są już tylko technologiczną ciekawostką. To broń, którą można kupić za kilkaset złotych i użyć przeciwko każdemu z nas.

Sztuczna inteligencja… po stronie atakującego

Sztuczna inteligencja pomaga nam w pracy, tłumaczeniach, tworzeniu treści – ale z tych samych możliwości korzystają dziś cyberprzestępcy. Co gorsza, AI nie tylko automatyzuje znane już ataki, ale też tworzy zupełnie nowe scenariusze, które są trudne do wykrycia i zaskakująco skuteczne.

AI potrafi przygotować idealnie dopasowanego maila phishingowego, bazując na naszych aktywnościach, zainteresowaniach, a nawet ostatnich zakupach. Już nie dostajemy wiadomości „Drogi użytkowniku” – teraz widzimy spersonalizowane treści, które wyglądają, brzmią i zachowują się jak prawdziwa komunikacja od znajomych lub firm.

Do tego dochodzą fałszywe oferty pracy, generowane przez AI – z poprawną polszczyzną, podlinkowaną stroną i… formularzem, który wyłudza dane osobowe. Równie niebezpieczne są chatboty udające konsultantów, które zadają pytania jak człowiek, ale służą wyłącznie kradzieży informacji.

AI potrafi w tym momencie znacznie więcej niż wielu się wydaje. Jej możliwości w tym zakresie to między innymi:

- tworzenie złośliwych dokumentów tekstowych i arkuszy, które wyglądają jak zwykłe pliki z pracy,

- budowanie fałszywych witryn internetowych, identycznych z oryginalnymi, i to w kilka sekund,

- imitowanie rozmów głosowych lub tekstowych, które sprawiają wrażenie realnej interakcji z człowiekiem.

Najgroźniejsze w tym wszystkim jest to, że ataki stają się coraz bardziej „ludzkie” – pozbawione literówek, dziwnego tonu czy widocznych śladów automatów. Zamiast więc szukać oczywistych błędów, musimy nauczyć się rozpoznawać subtelne sygnały, że coś jest nie tak.

Fałszywe aplikacje i rozszerzenia przeglądarki

Aplikacja wygląda profesjonalnie, ma setki pobrań i działa… do czasu. Coraz więcej złośliwego oprogramowania ukrywa się dziś pod postacią niby użytecznych aplikacji mobilnych albo rozszerzeń do przeglądarek, które kuszą obietnicą nowych funkcji, a tak naprawdę służą do kradzieży danych.

Z pozoru wszystko jest w porządku – aplikacja może rzeczywiście wykonywać swoją deklarowaną funkcję. Ale w tle przechwytuje dane logowania, śledzi naszą aktywność, a czasem nawet nagrywa ekran lub dźwięk. I to nie tylko w podejrzanych źródłach – takie przypadki zdarzają się również w oficjalnych sklepach z aplikacjami.

Podobnie działają rozszerzenia do przeglądarek, które oferują dodatkowe funkcje (np. tłumaczenia, blokowanie reklam, zarządzanie hasłami), ale jednocześnie monitorują wpisywane treści, kopiują dane formularzy lub zmieniają wyniki wyszukiwania, by przekierować nas na fałszywe strony.

Na co uważać?

- Sprawdzamy, kto jest wydawcą aplikacji lub rozszerzenia. Nie warto ufać programom od anonimowych twórców.

- Czytamy opinie, ale z dystansem – część recenzji to komentarze pisane przez boty lub opłacone w tym celu konta.

- Unikamy aplikacji, które proszą o dostęp do danych niepotrzebnych do działania – jeśli kalkulator chce mikrofonu i kontaktów, to coś jest nie tak.

Dziś samo „nieklikanie w podejrzane linki” już nie wystarcza – teraz wystarczy kliknąć „Zainstaluj” coś, co wygląda jak narzędzie do pracy lub rozrywki, żeby oddać kontrolę nad swoim urządzeniem

Ataki przez smart home i internet rzeczy

Nasze domy są coraz mądrzejsze, ale niestety – także bardziej podatne na ataki. Korzystamy z inteligentnych kamer, żarówek, głośników, zamków czy termostatów, często bez zastanowienia się, jak dobrze są one zabezpieczone. Tymczasem dla cyberprzestępców to doskonała brama do naszej prywatności, którą można wykorzystać bez potrzeby łamania haseł do komputera.

Niestety rośnie liczba ataków, w których celem są urządzenia tzw. internetu rzeczy. Wystarczy jedna niezaktualizowana kamera IP albo tani smart-zamek z niezałatanym błędem, by zyskać dostęp do całej naszej sieci domowej. Przez takie urządzenia można nie tylko podsłuchiwać, co dzieje się w domu, ale też przejąć kontrolę nad routerem, śledzić naszą aktywność w internecie albo zainfekować inne urządzenia – od laptopa po telewizor. Często nie zauważamy żadnych objawów, bo te ataki nie powodują typowych problemów jak spowolnienie czy błędy. Wszystko działa, ale w tle nasze dane mogą być kopiowane albo urządzenia stają się częścią tzw. botnetów, wykorzystywanych do kolejnych ataków na innych użytkowników.

Musimy traktować sprzęty smart home tak samo poważnie, jak komputery i telefony. Regularnie aktualizować ich oprogramowanie, zmieniać domyślne hasła, sprawdzać, czy komunikują się z nieznanymi serwerami. Bo choć sterowanie światłem z aplikacji jest wygodne, to oddanie komuś z zewnątrz dostępu do tego systemu może być dużo bardziej kosztowne niż niezgaszona lampa.

Socjotechnika nowej generacji: manipulacja przez media społecznościowe i AI-boty

Kiedyś łatwo było rozpoznać fałszywe konto – dziwne zdjęcie profilowe, zero znajomych, błędy językowe. Dziś to już nie działa. Obecnie fałszywe profile potrafią być lepiej prowadzone niż nasze własne, a stojące za nimi systemy sztucznej inteligencji prowadzą rozmowy, które wydają się zupełnie naturalne.

Wchodzimy w interakcje z kimś, kto komentuje nasze posty, zadaje pytania, udostępnia ciekawy link. Czasem to osoba podająca się za znajomego, czasem „ktoś z branży”, czasem nowo poznany „ktoś miły”. I nie podejrzewamy, że rozmawiamy z botem, który został zaprojektowany, by zebrać od nas określone informacje, skłonić do kliknięcia w link albo nawet wyciągnąć dane do logowania czy numer konta.

Niektóre ataki mają długoterminowy charakter – zaczynają się od zwykłej rozmowy, a kończą po tygodniach, kiedy nabierzemy zaufania. Inne są szybsze – np. bot udający konsultanta bankowego, który pisze do nas po „podejrzanej transakcji” i kieruje do fałszywej strony. Musimy nauczyć się nowego poziomu ostrożności. Już nie wystarczy ocenić zdjęcie profilowe czy nazwisko. Musimy zadawać pytania, które weryfikują, z kim naprawdę rozmawiamy. Musimy uważać, komu udostępniamy jakiekolwiek informacje – nawet te, które z pozoru nie mają znaczenia. Bo dziś socjotechnika nie wymaga już człowieka – wystarczy dobrze zaprogramowana AI, która wie, jak zdobyć nasze zaufanie.

Złośliwe reklamy i oszustwa „na subskrypcję”

W internecie trudno dziś odróżnić prawdziwą reklamę od tej, która ma nas tylko złapać w pułapkę. Złośliwe banery, sponsorowane posty i wyskakujące okienka wyglądają jak oferty znanych marek, często są nawet poprawnie przetłumaczone i zawierają logo, które wygląda identycznie jak oryginalne. Klikamy, bo chcemy promocji, darmowego okresu próbnego albo wyjątkowej okazji – i zanim się zorientujemy, akceptujemy regulamin ukrytej subskrypcji albo instalujemy złośliwe oprogramowanie. W ostatnich latach gwałtownie wzrosła liczba tzw. dark patterns, czyli interfejsów zaprojektowanych tak, byśmy podjęli decyzję, której normalnie byśmy nie podjęli. Klikamy „dalej”, „zgadzam się” lub „aktywuj”, nie wiedząc, że w tym momencie zapisujemy się do płatnej usługi, a z konta zaczyna znikać kilkanaście złotych miesięcznie. Czasem nawet nie dostajemy żadnego powiadomienia – po prostu przeoczyliśmy drobny druk.

Co gorsza, takie praktyki pojawiają się także w aplikacjach mobilnych. Pobieramy „darmową” grę albo narzędzie, a potem okazuje się, że w tle aktywowaliśmy automatyczne płatności. Wiele z tych aplikacji działa w tzw. modelu subskrypcji ukrytej – nie dostajemy faktury ani potwierdzenia, tylko comiesięczne obciążenie konta, które zauważamy po czasie.

Dlatego musimy być coraz bardziej czujni – nie tylko przy podejrzanych stronach, ale nawet przy „oficjalnych” promocjach. Zanim coś klikniemy, warto przeczytać, co naprawdę akceptujemy. W świecie, gdzie płatność może się aktywować jednym kliknięciem, ostrożność to nasza najważniejsza broń.

Zabezpieczenia takie jak antywirusy nie wystarczą. Trzeba zawsze zachowywać czujność. Grafika: HotGear

Oszustwa kryptowalutowe i NFT 2.0

Kryptowaluty nie zniknęły – wręcz przeciwnie, wracają co jakiś czas w nowej odsłonie i z nowymi, jeszcze bardziej wyszukanymi pułapkami. W nadchodzących latach oszustwa związane z kryptowalutami i tokenami będą wyglądać na coraz bardziej profesjonalne, a przestępcy umiejętnie połączą technologię blockchain z socjotechniką i sztuczną inteligencją.

Z jednej strony mamy fałszywe portfele, które wyglądają jak znane aplikacje, ale po podłączeniu od razu przejmują dostęp do środków. Z drugiej – oferty tzw. „airdropów”, czyli darmowych tokenów, które w rzeczywistości są tylko pretekstem do wyłudzenia naszych danych. Trafiamy na komunikat, że należą się nam kryptowaluty za samo zalogowanie się lub „połączenie” konta – a kończy się to utratą wszystkiego, co mieliśmy w portfelu.

Popularność zyskały też tzw. zombie-portfele – projekty, które przez kilka tygodni lub miesięcy wyglądają na wiarygodne, zdobywają zaufanie, a potem nagle znikają z pieniędzmi użytkowników. Twórcy takich oszustw potrafią generować realistyczne komentarze inwestorów, a nawet animowane prezentacje, które niczym nie odbiegają od prawdziwych startupów.

Nową odmianą są też boty inwestycyjne bazujące na AI, które obiecują „automatyczny zysk” bez naszego zaangażowania. Wystarczy wpłacić określoną kwotę i w teorii system zrobi wszystko za nas. W praktyce – nikt tych pieniędzy już nie zobaczy.

W świecie krypto nadal obowiązuje podstawowa zasada, którą zbyt łatwo ignorujemy: jeśli coś wygląda zbyt dobrze, by było prawdziwe – prawdopodobnie takie właśnie jest. I nawet jeśli mamy do czynienia z technologią przyszłości, to nadal najczęściej oszukiwany jest po prostu człowiek.

Fałszywe aktualizacje i pliki „z AI”

W czasach, gdy coraz więcej osób korzysta z narzędzi opartych na sztucznej inteligencji, cyberprzestępcy błyskawicznie wykorzystali modę na AI do tworzenia nowych metod ataku. W sieci pojawiło się mnóstwo fałszywych instalatorów popularnych aplikacji, takich jak ChatGPT, Midjourney czy różnego rodzaju „offline assistantów”, rzekomo działających bez potrzeby łączenia z internetem. Prawdziwe wersje tych programów zazwyczaj funkcjonują wyłącznie online, ale fałszywki udają, że da się je zainstalować lokalnie — i to właśnie one zawierają złośliwe oprogramowanie.

Podobny problem dotyczy aktualizacji oprogramowania. Na ekranie może pojawić się komunikat, że nasze oprogramowanie wymaga pilnej poprawki – wystarczy kliknąć i zainstalować. Problem w tym, że nie pochodzi on od rzeczywistego systemu, tylko z podstawionego skryptu na stronie internetowej, która wygląda jak oficjalna witryna producenta. Zamiast poprawki dostajemy trojana, który przejmuje kontrolę nad systemem albo szyfruje dane w celu wymuszenia okupu.

Wzrosła też liczba fałszywych dokumentów „wygenerowanych przez AI”, które są przesyłane jako załączniki – raporty, CV, analizy, oferty współpracy. Otwieramy je z ciekawości, bo wyglądają profesjonalnie. Ale zanim zdążymy je przeczytać, nasz komputer zaczyna wykonywać skrypty osadzone wewnątrz pliku, nawet bez naszej wiedzy.

Musimy nauczyć się nowego nawyku: nie ufajmy plikom, które wyglądają „technologicznie”, tylko dlatego, że podpisane są hasłami typu AI, GPT, neural engine czy pro update. Popularność tych terminów stała się idealnym narzędziem do manipulacji i podsuwania nam niebezpiecznych treści pod przykrywką nowoczesności.

Podsumowanie

Internet to przestrzeń, która potrafi być równie użyteczna, co niebezpieczna. Nowe zagrożenia nie krzyczą już z ekranu – działają po cichu, inteligentnie, często bez naszego udziału. Deepfake’i, złośliwe rozszerzenia, ataki przez smart home czy oszustwa związane z kryptowalutami – wszystkie te metody mają jedną wspólną cechę: są trudniejsze do wykrycia niż kiedykolwiek wcześniej. Musimy zmienić nasze podejście do bezpieczeństwa. Nie wystarczy już ostrożność – potrzebna jest świadomość, że zagrożenia mogą przyjść z kierunków, których wcześniej nie braliśmy pod uwagę. Musimy aktualizować nie tylko oprogramowanie, ale też nasze nawyki. Weryfikować źródła, dbać o prywatność, nie ufać ślepo nawet najbardziej profesjonalnym komunikatom.

Najlepszym zabezpieczeniem nie są programy antywirusowe, tylko nasza czujność i zdrowy rozsądek. W erze, w której cyberprzestępcy korzystają z tych samych narzędzi co my – przewagę zyskamy tylko wtedy, gdy nauczymy się myśleć jak oni… i wyprzedzać ich o krok.

Tomasz Sławiński

KOMENTARZE (0) SKOMENTUJ ZOBACZ WSZYSTKIE